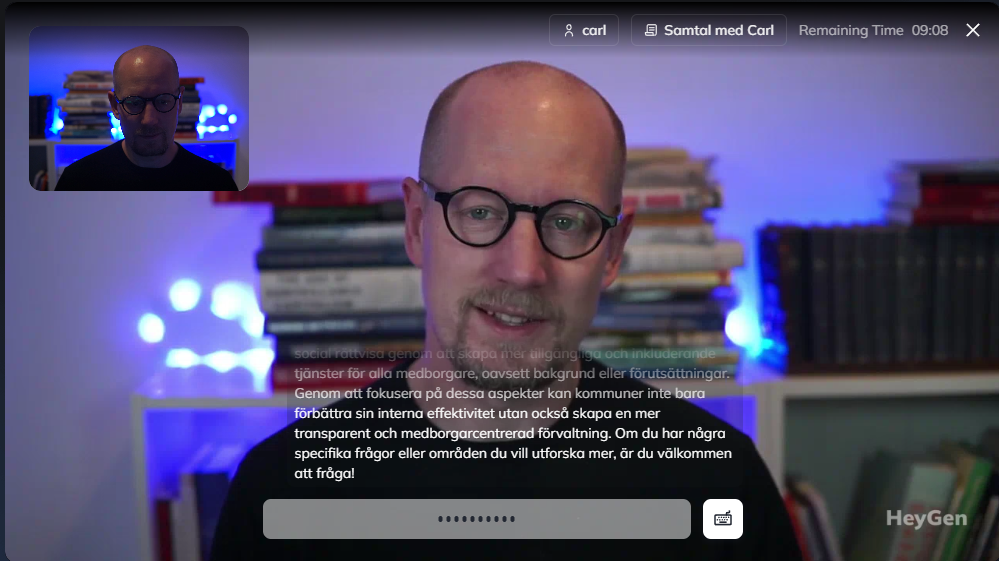

Så har jag gått och blivit med en klon. Eller i alla fall en digital avatar som försöker efterlikna mig. Nu kan du testa att prata med den du med, och se vad du tycker, tänker och känner inför utvecklingen.

Vi börjar se hur gränsen mellan människa och maskin blir allt tunnare för varje dag som går. När jag sitter här framför min dator och ser en exakt digital kopia av mig själv på skärmen, slås jag av hur snabbt tekniken har utvecklats. För bara några år sedan var detta science fiction – nu är det min verklighet. Det är en skön oktoberdag och jag har kommit in efter en höstpromenad och slagit mig ner framför datorn. Efter att ha tränat en AI på min röst och mitt utseende, och gjort en gäng inställningar, så dyker min digitala tvilling plötsligt upp på skärmen framför mig. En avatar som rör sig, talar och gestikulerar rät så likt hur jag gör. Utseendemässigt är det väldigt nära. Jag har svårt att se att detta är en tränad AI. Min röst är också den rätt bra, särskilt om jag pratar svenska eller engelska. Det känns nästan overkligt att se mig själv utanför mig själv så här.

Men mina äventyr med att försöka klona mig själv går en bra bit tillbaka. Redan 2015 på Interactive Institute började jag experimentera tillsammans med mina kollegor och utforskade idén om att skapa en fysisk klon. Vi 3D-printade delar av en robot och drömde om en framtid där en mekanisk version av oss kunde vandra omkring och hålla föreläsningar eller hjälpa till på olika sätt. Men vi var för tidigt ute. Tekniken var inte redo för våra visioner. Vi kom så långt att vi printade ett huvud, en torso och en vänsterarm, sen blev det en lång paus.

Nu, nästan ett decennium senare, har teknologin hunnit ikapp. Med hjälp av HeyGens AI-plattform har jag skapat en fullt funktionell digital avatar av mig själv. Min virtuella version kan inte bara se ut och låta som jag – den kan interagera i realtid, svara på frågor och till och med delta i videokonferenser i Zoom. Jag har tränat den på en instruktion om vem jag är, mina intressen och kunskaper, för att hjälpligt efterlikna hur jag skulle resonera. Häri ligger svagheten idag. Det är svårt att träna en digital klon på ens egen kunskap till den grad att de är trovärdiga. De fungerar bra i syntaxen eller i en instrumentell version av en själv. Men eftersom den saknar förmåga att förstå mening och sammanhang, förblir den en tämligen trist robot på många sätt.

Samtidigt är det fascinerande att se hur långt vi har kommit. HeyGens teknologi använder en kombination av flera olika AI-tekniker, tillsammans med video för att skapa en väldigt trovärdig digital representation. Systemet har analyserat videomaterial och ljudinspelningar av mig för att fånga nyanserna av mitt tal, mina ansiktsuttryck och mitt kroppsspråk. Resultatet är en avatar som kan generera nya, kontextbaserade svar i realtid, allt medan den försöker efterlikna mig, eller snarare den instruktion jag gett den om mig.

Möjligheterna med teknologin är många. Jag ser hur en avatar som min skulle kunna fungera som en förlängning av mig själv i situationer där en distribuerad version hade varit värdeskapande, så som i att ge stöd i undervisning jag har, dygnet runt, när som helst. Eller för den delen kunna hantera enklare administrativa ärenden digitalt, som att vara en avancerad telefonsvarare om jag inte kan prata. Men med stora möjligheter kommer också många problem. I takt med att det blir allt enklare att skapa övertygande digitala kopior av verkliga personer, öppnas dörren för potentiellt problematiska användningsområden. Begreppet ”malign counterfeit human” har dykt upp för att beskriva några av de möjliga negativa konsekvenser som framträder med denna nya teknologi. Vi har redan sett exempel på hur deepfake-teknik kan användas för att manipulera videomaterial i politiska syften eller för sofistikerade bedrägerier. Med den här utvecklingen lär vi se mer av detta framöver.

Frågorna hopar sig. Hur säkerställer vi autenticitet i en värld där vem som helst kan skapa en övertygande kopia av någon annan? Hur skyddar vi oss mot desinformation och manipulation när gränsen mellan äkta och fabricerat innehåll blir allt svårare att urskilja? Det handlar inte bara om tekniska lösningar. Vi behöver utveckla nya regelverk som kan hålla jämna steg med den snabba tekniska utvecklingen. Medie- och informationskunnighet kommer fortsatt att vara oerhört viktigt. Men när det inte längre på ett enkelt sätt går att skilja vad som är syntetiskt från vad som är äkta behöver vi hitta andra vägar för att säkerställa att samhället förmår fortsatt ha en opinionsbildning som fungerar. En demokrati som står sig stark också i en digital tid. Som det är idag är vi inte rustade för framväxten av ett syntetiskt medielandskap. När det blir billigare, enklare och snabbare att skapa innehåll med AI, jämfört med andra metoder, till likvärdig effekt, så kommer det att ske.

Trots utmaningarna väljer jag att vara kritiskt positiv inför framtiden. Jag ser digitala tvillingar och avatarer som verktyg för lärande, underhållning och mycket annat. För min del är det också viktigt att förstå och utforska tekniken, för att se vilka problem och utmaningar den bär med sig. Vi står inför en ny era av mänsklig representation och interaktion. Det är upp till oss att forma denna framtid på ett ansvarsfullt och etiskt sätt.

Men bland alla dessa tankar är det samtidigt något märkligt att sitta här och träna en digital version av sig själv. Det väcker många tankar, inte minst om vad det innebär att vara människa. Vad som är medvetande, hur vi tänker, känner, lär och lever. För det blir uppenbart i interaktionen med dessa digitala avatarer att de fortfarande är rätt så platta. Även om de ser och låter bra, så saknas det fortfarande mycket för att vara något mer än en funktion, ett verktyg. Åtminstone en tid till.

Lämna ett svar